PixarがパイプラインでUSDをどのように使用するかについて、簡単な入門記事が公開されています。https://renderman.pixar.com/stories/pixars-usd-pipeline USDはこ […]

Technical

バニーガール3Dモデルリグ

かわいいバニーリグが販売されてます。価格は$18。 https://flippednormals.com/downloads/bunny-girl-3d-model-rig/ バニーガール3Dモデルリグ このファイルには […]

Amanda RIG v .1.0

Mayaのキャラクターリグが公開されてます。全身にリグが仕込んであるので、解析すれば色々参考になりそうです。複雑なことしてそうだけどリグの動作が軽い。 https://gumroad.com/l/qMtRcV

3Dアニメーションソフトウェア「Rumba」

3Dアニメーションソフトウェア「Rumba」。開発はGuerilla RenderのMercenaries Engineering。現在クローズドベータ中のようです。 https://rumba-animation.co […]

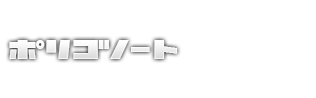

セガゲームスのTA向け新人研修カリキュラム

「テクニカルアーティスト向けの新人研修とは? セガゲームスの特別カリキュラムを一挙公開」という記事が公開されます。現在のゲームに必要な知識がまとまってる感じがします。 https://cgworld.jp/intervi […]

SIGGRAPH Asia 2019 – Technical Papers Trailer

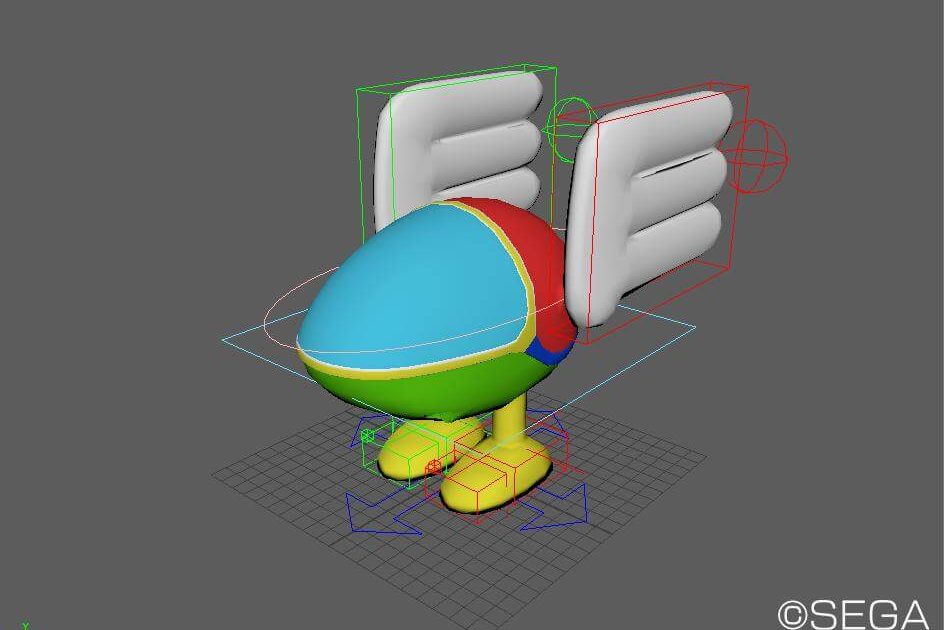

服飾アニメーションのインタラクティブオーサリングのための組み込みの服飾スペース学習

クロスアニメーションのインタラクティブオーサリングに関する研究のようです。メッシュを入力すると間を補完してくれる的な物のようです。 http://geometry.cs.ucl.ac.uk/projects/2019/g […]

Transport-Based Neural Style Transfer for Smoke Simulations

画像を使用してスモークシミュレーションにスタイルを転送する技術だそうです。面白い。 http://www.byungsoo.me/project/neural-flow-style/index.html 概要 芸術的に流 […]

Brevant Houdini sims

HoudiniとRedshiftでレンダリング。

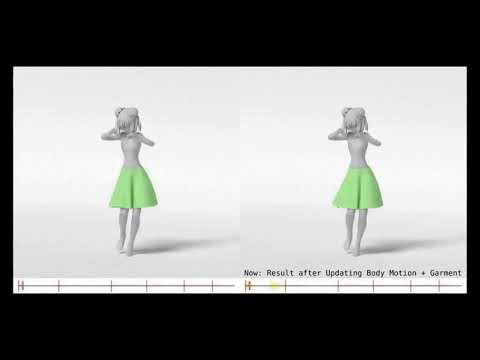

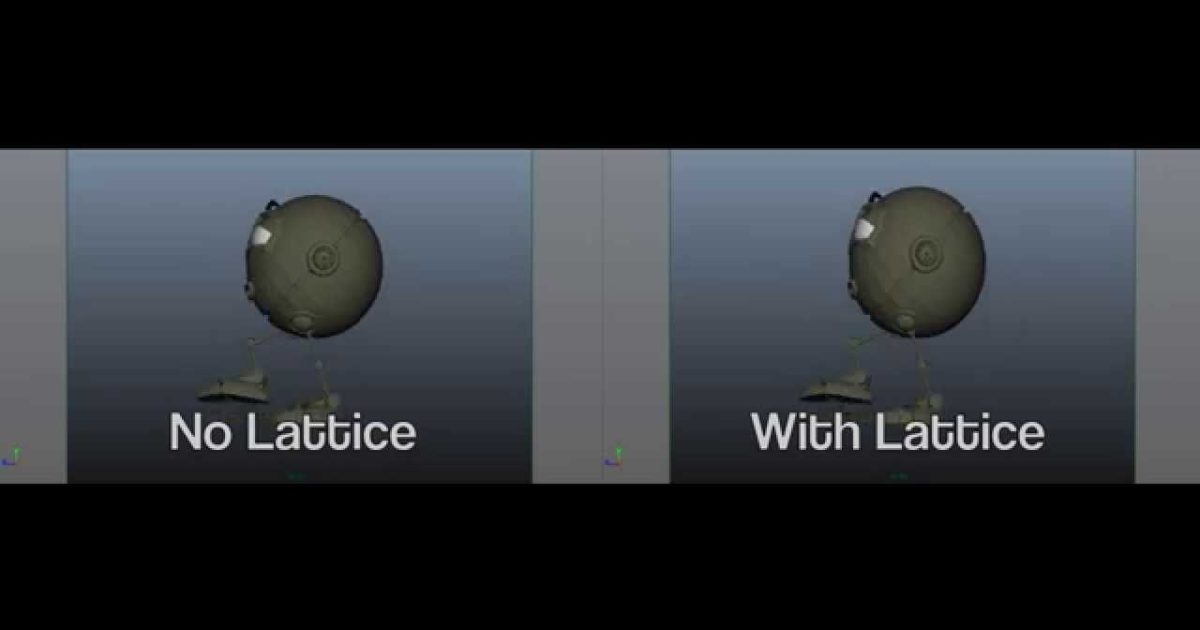

Toolchefs Camera Lattice for Maya

オープンソースのMayaアニメーションツールをリリースしているToolchefsが、Camera Latticeツールを公開しました。tcKeyReducer、harmonicDeformer、tcSoftIKSolve […]

Continuum Damage Material Point Methods for Dynamic Fracture Animation

動的破壊アニメーションの連続体損傷の重要なポイントメソッド。とのことで物体のちぎれる様子がリアルにシミュレーションできてて凄い。 https://www.seas.upenn.edu/~cffjiang/

より正確なマルチビューヘアキャプチャ

毛髪は再建するのが最も困難な目的の1つだそうですが、ストランドレベルの精度で忠実度の高いヘアジオメトリをキャプチャする論文とビデオが公開されてるようです。 髪の毛のキャプチャーと言えばディズニーの研究を思い出します。需要 […]

Incredibles 2のエンジニアリングに忠実な髪

Pixar が Incredibles 2 向けに開発したヘアワークフローを紹介するビデオをアップロードしています。 SIGGRAPH 2018でおこなう講演用らしい。プレビューでの再現性が高そうですね。

Technical Papers Preview: SIGGRAPH 2018

スマフォ使ったAIモーションキャプチャ「RADiCAL」

スマフォで撮影した動画からモーションキャプチャーするサービスだそうです。動画をサーバーにアップして解析し、FBX形式でダウンロード可能とのこと。現在ベータ版でモーションキャプチャのプレビューを5分間無料で利用できます。 […]